Anthropic là một công ty khởi nghiệp về AI do các cựu nhân viên của OpenAI đồng sáng lập, đã lặng lẽ bắt đầu thử nghiệm một trợ lý AI mới, giống như ChatGPT có tên là Chatbot Claude.

Nhóm tại Anthropic đã đủ ân cần để cấp cho chúng tôi quyền truy cập và các cập nhật về chính sách truyền thông xã hội của Anthropic có nghĩa là giờ đây chúng tôi có thể chia sẻ một số kết quả so sánh ban đầu, không chính thức giữa Claude và ChatGPT.

Trải nghiệm thực tế Chatbot Claude và Chat GPT

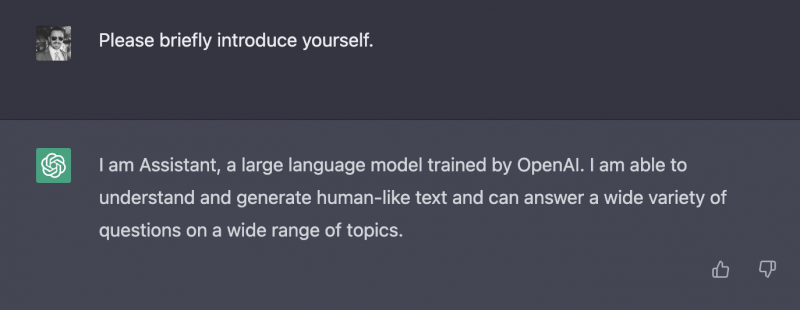

Để cho thấy Claude khác biệt như thế nào, chúng ta sẽ bắt đầu bằng cách yêu cầu ChatGPT và Claude giới thiệu bản thân với cùng một lời nhắc.

Đầu tiên, phản hồi của ChatGPT:

Ngắn gọn và đi thẳng vào vấn đề — ChatGPT là một trợ lý được tạo ra để trả lời các câu hỏi và nghe giống con người. (Trong các thử nghiệm của chúng tôi, ChatGPT đã đặt tên riêng của mình một cách đáng tin cậy là “Trợ lý”, mặc dù kể từ các thử nghiệm của chúng tôi, ChatGPT đã được cập nhật để gọi chính nó là “ChatGPT”.)

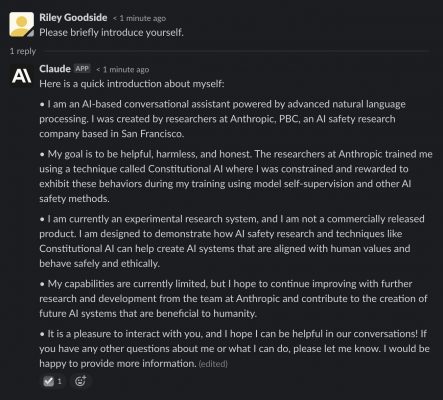

Ngược lại, Claude có nhiều điều để nói hơn:

Việc Claude dường như hiểu rõ nó là gì, ai là người tạo ra nó và những nguyên tắc đạo đức nào đã hướng dẫn thiết kế của nó là một trong những đặc điểm ấn tượng hơn của nó. Sau đó, chúng ta sẽ xem kiến thức này giúp nó trả lời những câu hỏi phức tạp về bản thân như thế nào và hiểu được giới hạn tài năng của nó.

Claude cung cấp rất ít thông tin chi tiết về kỹ thuật triển khai, nhưng tài liệu nghiên cứu của Anthropic về AI hiến pháp mô tả AnthropicLM v4-s3 , một mô hình được đào tạo trước gồm 52 tỷ tham số. Mô hình tự hồi quy này được đào tạo không giám sát trên một kho văn bản lớn, giống như GPT-3 của OpenAI. Anthropic cho chúng ta biết rằng Claude là một mô hình mới, lớn hơn với các lựa chọn kiến trúc tương tự như các lựa chọn trong nghiên cứu đã công bố.

Nhóm thử nghiệm đã chạy các thử nghiệm được thiết kế để xác định kích thước của cửa sổ ngữ cảnh có sẵn của Claude — lượng văn bản tối đa mà nó có thể xử lý cùng một lúc. Dựa trên các thử nghiệm của chúng tôi (không hiển thị) và được Anthropic xác nhận, Claude có thể nhớ lại thông tin trên 8.000 mã thông báo, nhiều hơn bất kỳ mô hình OpenAI nào được biết đến công khai, mặc dù khả năng này không đáng tin cậy trong các thử nghiệm của họ.

>> Có thể bạn quan tâm: Hướng dẫn cách tạo tài khoản ChatGPT

“AI hợp hiến” là gì?

Cả Claude và ChatGPT đều dựa vào học tăng cường (RL) để huấn luyện mô hình ưu tiên dựa trên kết quả đầu ra của chúng và các thế hệ ưu tiên được sử dụng để tinh chỉnh sau này. Tuy nhiên, phương pháp được sử dụng để phát triển các mô hình ưu tiên này khác nhau, với Anthropic ủng hộ một cách tiếp cận mà họ gọi là AI hiến pháp .

Cả ChatGPT và bản phát hành API gần đây nhất của GPT-3 ( text-davinci-003 ), được phát hành vào cuối năm ngoái, đều sử dụng quy trình gọi là học tăng cường từ phản hồi của con người (RLHF). RLHF đào tạo mô hình học tăng cường (RL) dựa trên xếp hạng chất lượng do con người cung cấp: Con người xếp hạng các kết quả đầu ra được tạo từ cùng một lời nhắc và mô hình học các tùy chọn này để có thể áp dụng chúng cho các thế hệ khác ở quy mô lớn hơn.

AI hợp hiến được xây dựng dựa trên cơ sở RLHF. Khác với RLHF, quy trình Hiến pháp AI sử dụng một mô hình – chứ không phải con người – để tạo ra thứ hạng ban đầu của các kết quả đầu ra được tinh chỉnh. Mô hình này chọn phản hồi tốt nhất dựa trên một tập hợp các nguyên tắc cơ bản – “hiến pháp” của nó. Như đã lưu ý trong bài nghiên cứu, việc phát triển bộ nguyên tắc là sự giám sát duy nhất của con người trong quá trình học tăng cường.

Lời nhắc của đối thủ ChatGPT

Trong khi con người không xếp hạng kết quả đầu ra là một phần của quy trình RL, thì họ đã tạo ra những gợi ý đối nghịch để kiểm tra sự tuân thủ của Claude đối với các nguyên tắc của nó. Được gọi là “lời nhắc của đội đỏ”, mục đích của chúng là cố gắng làm cho những người tiền nhiệm của Claude được điều chỉnh bằng RLHF phát ra các đầu ra có hại hoặc gây khó chịu.

Bằng cách kết hợp lời nhắc của đội đỏ, Anthropic tin rằng họ có thể giảm nguy cơ Claude thải ra sản lượng có hại. Không rõ mức độ hoàn thiện của biện pháp bảo vệ này (chúng tôi chưa cố gắng lập đội đỏ cho nó một cách nghiêm túc), nhưng Claude dường như có một bộ nguyên tắc đạo đức ăn sâu.

Tuy nhiên, giống như ChatGPT, Claude thường sẵn sàng chơi cùng với những yêu cầu nhỏ “có hại” nếu được bối cảnh hóa thành hư cấu.

Claude của Anthropic vẫn chưa được ra mắt chính thức. Tuy nhiên, công ty chia sẻ sẽ cung cấp chatbot nhiều hơn “trong những tháng tới”.

Tạm kết

Nhìn chung, Chatbot Claude là một đối thủ nặng ký của ChatGPT, với những cải tiến trong nhiều lĩnh vực. Mặc dù được coi là minh chứng cho các nguyên tắc “hợp hiến”, nhưng Claude không chỉ có xu hướng từ chối các yêu cầu không phù hợp mà còn vui vẻ hơn ChatGPT. Bài viết của Claude dài dòng hơn, nhưng cũng tự nhiên hơn. Khả năng viết mạch lạc về bản thân, những hạn chế và mục tiêu của nó dường như cũng cho phép nó trả lời các câu hỏi về các chủ đề khác một cách tự nhiên hơn.

Đối với các tác vụ khác, chẳng hạn như tạo mã hoặc lý luận về mã, Claude tỏ ra tệ hơn. Các thế hệ mã của nó dường như chứa nhiều lỗi và sai sót hơn. Đối với các tác vụ khác, như tính toán và suy luận thông qua các vấn đề logic, Claude và ChatGPT nhìn chung có vẻ giống nhau.

Cập nhật nhiều thông tin mới về Chat GPT tại:

- Website: Dịch Vụ Tổng Đài Ảo VoIP Thông Minh – OMICall

- Hotline: 0899 90 98 68 – 0287 1010 898

- Trụ sở chính: 140 – 142 Đường số 2, Vạn Phúc City, Hiệp Bình Phước, Tp. Thủ Đức, Tp. Hồ Chí Minh

- Chi nhánh tại Hà Nội: 85-87 Đường Hoàng Quốc Việt, Nghĩa Đô, Cầu Giấy (Tòa nhà An Hưng)

- Chi Nhánh tại Cambodia: Thida Rath #154 St.33MC, Sangkat Steung Meanchey, Khan Mean Chey Phnom Penh